Como saber se o vídeo que você está assistindo foi feito com IA

Este artigo é parte da série “Expondo a IA” do Lifehacker. Estamos explorando seis tipos diferentes de mídia gerada por IA e destacando os quesitos, subprodutos e marcas comuns que ajudam a diferenciar o conteúdo criado por IA do criado por humanos.

As empresas de IA estão animadas com os geradores de vídeo: eles destacam as possibilidades criativas que esses novos modelos oferecem e se deliciam com o quão impressionantes são os resultados finais. No entanto, do meu ponto de vista, uma tecnologia que permite a qualquer pessoa criar vídeos realistas com um simples prompt não é divertida ou promissora, mas assustadora. Você realmente quer viver em um mundo em que qualquer vídeo que você vir online poderia ter sido criado do nada com IA? Goste ou não, é para onde estamos indo.

Quando você dá a más intenções as ferramentas para manipular vídeos em um grau que muitas, se não a maioria, das pessoas acreditarão que são reais de passagem, você está jogando gasolina em uma fogueira que tem estado acesa desde que a primeira pessoa mentiu na internet. Agora, mais do que nunca, é importante estar vigilante sobre o que vemos online e ter um olhar crítico para qualquer vídeo que alegue representar a realidade - especialmente quando essa realidade é destinada a nos provocar ou influenciar nossa visão do mundo.

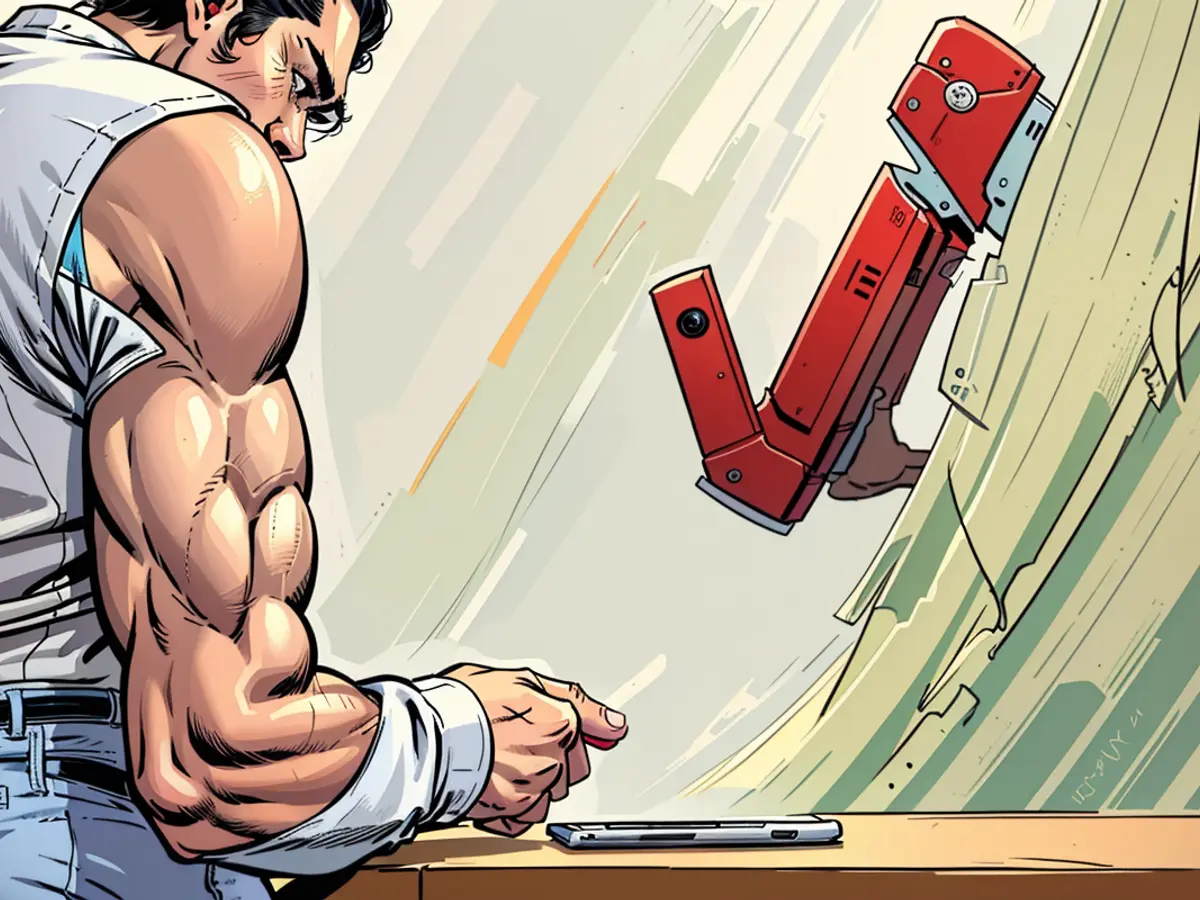

Os vídeos da IA não são todos iguais

Há basicamente dois tipos de vídeos da IA para se ter em mente no momento. O primeiro são vídeos totalmente gerados por modelos de IA, sequências inteiras que usam nenhum material real e nunca existiram antes de serem produzidos. Pense no modelo Sora da OpenAI, que é capaz de renderizar vídeos curtos e de alta qualidade que poderiam facilmente enganar as pessoas para pensar que são reais. Felizmente para nós, o Sora ainda está em desenvolvimento e não está disponível publicamente, mas há outras ferramentas que aquelas que sabem podem usar para gerar esses vídeos do zero.

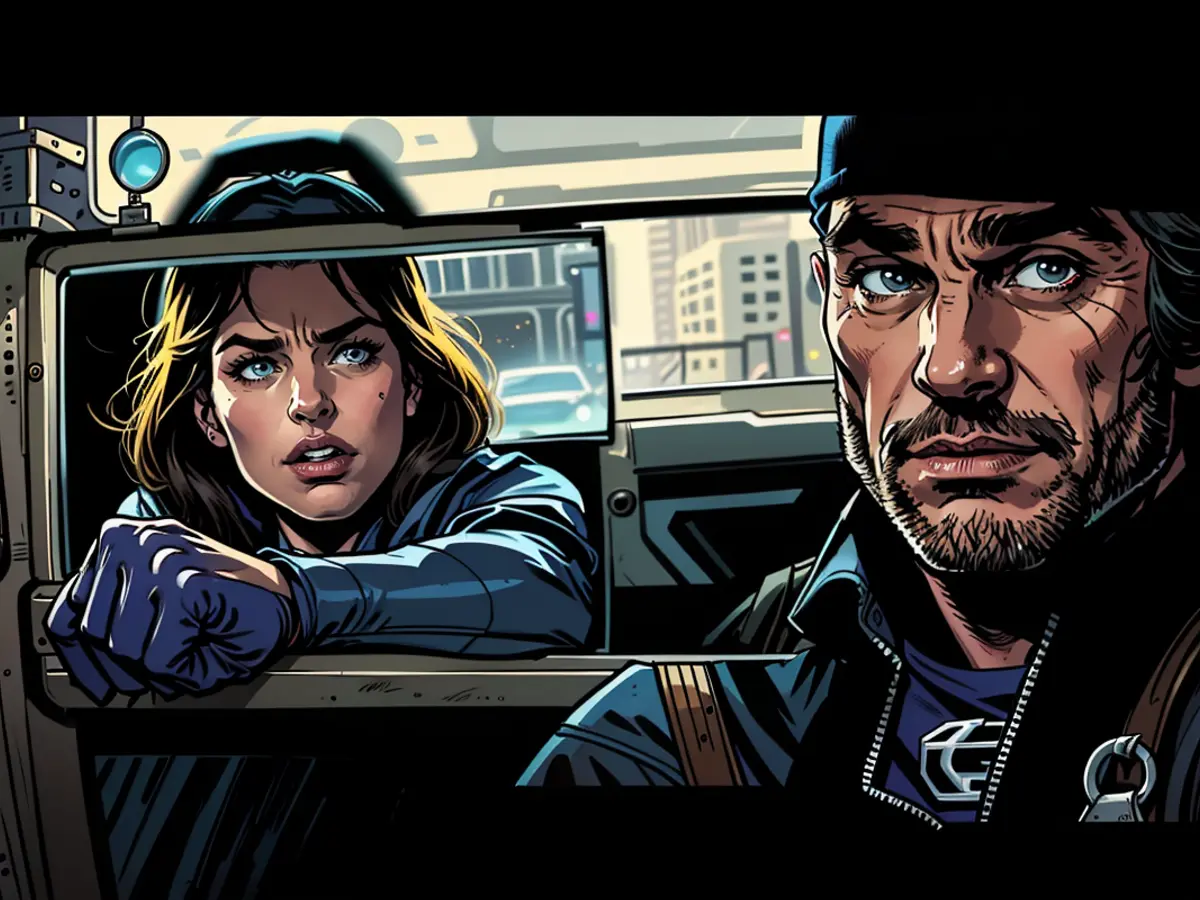

O que é mais relevante agora e mais preocupante para as implicações de curto prazo são os vídeos alterados pela IA. Pense em deepfakes: vídeos reais que usam IA para sobrepor um rosto de uma pessoa em outro ou para alterar um rosto real para combinar com o conteúdo de áudio manipulado.

Vamos cobrir maneiras de detectar ambos os tipos de conteúdo de vídeo da IA: à medida que os geradores de vídeo da IA melhoram e se tornam mais acessíveis, você pode começar a ver esses vídeos aparecerem online da mesma maneira que as imagens da IA explodiram. Fique vigilante.

Como os geradores de vídeo da IA funcionam

Assim como outros modelos de IA gerativos, os geradores de vídeo da IA são alimentados com uma enorme quantidade de dados para funcionar. Enquanto os modelos de imagem da IA são treinados em imagens individuais e aprendem a reconhecer padrões e relações em peças estáticas, os geradores de vídeo da IA são treinados para procurar a relação entre várias imagens e como essas imagens mudam em sequência. Afinal, um vídeo é basicamente uma série de imagens individuais, reproduzidas a uma velocidade que cria a ilusão de movimento. Se você quiser que um programa gere vídeos do nada, não apenas precisa que eles sejam capazes de gerar os sujeitos desses vídeos, mas também saber como esses sujeitos devem mudar quadro a quadro.

Os programas de deepfake são especificamente treinados em faces e projetados para imitar os movimentos e emoções do vídeo que estão sobrepondo. Eles frequentemente usam uma rede adversarial gerativa (GAN), que coloca dois modelos de IA um contra o outro: um que gera conteúdo da IA e outro que tenta identificar se esse conteúdo é gerado pela IA. Por outro lado, um modelo como o Sora é, em teoria, capaz de gerar vídeo sobre qualquer coisa que você possa pedir. O Sora é o que é conhecido como um modelo de difusão, que adiciona "ruído" (realmente estática) aos dados de treinamento até que a imagem original desapareça. A partir daqui, o modelo tentará criar uma nova versão desses dados a partir do ruído, o que o treina para criar novo conteúdo do zero.

São ainda os primeiros dias para a geração total de vídeo da IA, e enquanto a tecnologia de deepfake é boa, não é ótima. Há limitações aqui que podem não estar presentes nas iterações futuras dessas tecnologias, mas, até hoje, há sinais que você pode procurar para dizer se o vídeo que você está assistindo é realmente real ou algo manipulado.

Os rostos não parecem exatamente certos

A tecnologia de sobrepor um rosto de uma pessoa em outro é impressionante, mas está longe de ser perfeita. Em muitos (se não a maioria) dos casos, um deepfake terá sinais óbvios de falsificação. Muitas vezes, parece uma Photoshop medíocre: o rosto não se mistura com o resto da cabeça da pessoa, a iluminação não combina com a cena em que está inserida e o conjunto tem um efeito de val

Como os geradores de imagens de IA, os geradores de vídeos de IA produzem vídeos com glitches e artefatos estranhos. Você pode notar as folhas de uma árvore piscando enquanto a câmera se move em direção a elas, ou pessoas andando em segundo plano com uma taxa de quadros diferente do resto do vídeo. Embora o vídeo abaixo pareça realista à primeira vista, está cheio desses glitches, especialmente nas árvores. (Aliás, repare como os carros na estrada à esquerda desaparecem constantemente.)

Mas o pior de todos? Deepfakes. Esses vídeos geralmente parecem horrendos, como se tivessem sido baixados e reuploadados milhares de vezes, perdendo toda a fidelidade no processo. Isso é de propósito, numa tentativa de mascarar os defeitos presentes no vídeo. A maioria dos deepfakes se denunciaria instantaneamente se fosse apresentada em 4K, já que a alta resolução do vídeo destacaria todos os seus defeitos mencionados. Mas quando você reduz a qualidade, fica mais fácil esconder essas imperfeições, e, assim, mais fácil enganar as pessoas para acreditar que o vídeo é real.

A física está errada

Uma câmera de vídeo captará o mundo como ele é, pelo menos na medida em que a lente e o sensor são capazes. Um gerador de vídeo de IA, por outro lado, cria vídeos com base no que viu antes, mas sem nenhum contexto adicional. Não sabe de nada, então preenche as lacunas da melhor forma que pode. Isso pode levar a uma física engraçada em vídeos gerados por IA.

Por exemplo, Sora gerou um vídeo de uma igreja em um penhasco ao longo da Costa Amalfitana. À primeira vista, parece bastante convincente. No entanto, se você prestar atenção ao mar, verá que as ondas estão se movendo para longe da costa, na direção oposta àquela em que deveriam se mover.

O gerador também produziu um vídeo de superfície convincentemente realista de um homem correndo em uma esteira. A grande dica aqui é que o homem está correndo "para a frente" enquanto vira as costas para a esteira, já que o modelo não entende exatamente como as esteiras devem funcionar. Mas, olhando de perto, você pode ver que a passada do homem não é normal: é como se a metade superior do corpo dele pare por um momento, enquanto a metade inferior continua. No mundo real, isso não seria realmente possível, mas Sora não entende como a física da corrida deveria funcionar.

Em outro vídeo, "arqueólogos" descobrem uma cadeira de plástico nas areias do deserto, puxando-a e limpando-a. Embora isso seja uma solicitação complicada para o modelo e ele renderize alguns momentos realistas, a física envolvida em toda a empreitada está muito errada: a cadeira aparece do nada, a pessoa que a segura a carrega de uma forma que nenhuma pessoa faria, e a cadeira acaba flutuando sozinha, distorcendo-se completamente no final do clipe.

Há muitos membros

Os modelos de IA que produzem esse conteúdo de vídeo não entendem quantos membros você deveria ter. Eles fazem a conexão de que os membros se movem entre os quadros, mas não entendem que deveria ser os mesmos membros ao longo da cena.

É por isso que você verá braços, pernas e patas aparecendo e desaparecendo ao longo de um vídeo. Embora não aconteça o tempo todo, você pode ver isso neste vídeo do Sora: enquanto a "câmera" acompanha as mulheres andando para a frente, há uma terceira mão que balança na frente dela, visível entre o braço esquerdo e o lado esquerdo dela. É sutil, mas é o tipo de coisa que os geradores de vídeo de IA farão.

Neste exemplo, olhe muito de perto no gato: perto do final do clipe, ele gera uma terceira pata, já que o modelo não entende que esse tipo de coisa geralmente não acontece no mundo real. Por outro lado, enquanto a mulher rola na cama, seu "braço" parece se transformar nos lençóis.

As coisas não fazem sentido

Membros extras não fazem muito sentido, mas é mais do que isso em um vídeo de IA. Novamente, esses modelos não sabem de nada: eles simplesmente tentam replicar o prompt com base no conjunto de dados em que foram treinados. Eles sabem que uma cidade na Costa Amalfitana deveria ter muitas escadarias de pedra, mas não parecem entender que essas escadarias têm que levar a algum lugar. No vídeo de demonstração da OpenAI, muitas dessas escadas são colocadas aleatoriamente, sem destino real.

Neste mesmo vídeo, observe as "pessoas" na multidão. À primeira vista, pode parecer um grupo de turistas passeando pela cidade, mas alguns desses turistas desaparecem no ar. Alguns parecem estar descendo as escadas, mas não estão usando as escadas para lugar nenhum: simplesmente "descem as escadas" no chão nivelado.

Olhe, tem sido importante tomar as coisas que você vê na internet com um grão de sal há algum tempo agora. Você não precisa de IA para escrever posts de blog enganosos que distorcem a verdade, ou para manipular um clipe de vídeo para enquadrar a história do jeito que você quer. Mas a vídeo de IA é diferente: não apenas o próprio vídeo é manipulado, mas a coisa toda pode nunca ter acontecido. É uma pena que temos que abordar a internet (e o mundo em geral) tão ceticamente, mas quando um único prompt pode produzir um vídeo inteiro do nada, qual outra escolha temos?

No campo dos avanços tecnológicos, a capacidade de criar vídeos realistas de IA usando prompts simples gerou tanto entusiasmo quanto preocupação. É uma espada de dois gumes, já que ferramentas como o modelo Sora podem gerar vídeos de alta qualidade que poderiam potencialmente enganar os espectadores.

Com o surgimento de geradores de vídeo de IA, é fundamental manter-se alerta e avaliar criticamente qualquer conteúdo de vídeo que alegue representar a realidade, especialmente se tiver como objetivo provocar ou influenciar nossas perspectivas. Isso é ainda mais verdadeiro à medida que a IA se torna mais acessível e começamos a ver essas manipulações de vídeo aparecerem na internet em maior número.

Leia também:

- A Telefónica pretende lançar no mercado a telefonia por holograma

- vzbv: As empresas de Internet continuam a fazer batota apesar da proibição

- A Telefónica prevê o lançamento no mercado da telefonia por holograma em 2026

- Quase nenhuma melhoria no equilíbrio ecológico dos sistemas informáticos do governo federal